Microsoft는 휴대폰에서 실행할 수 있을 만큼 작은 Phi-3 미니 모델을 공개했습니다

대규모 언어 모델(LLM)은 복잡한 작업을 이해하고 수행할 수 있는 기능을 제공하지만, 소규모 모델은 스마트폰과 PC에서 로컬로 사용할 수 있기 때문에 그에 못지않게 중요합니다. 그리고 Microsoft는 인상적인 소형 언어 모델을 개발하고 있는 것으로 보입니다. 최신 Phi-3 Mini 모델이 공개되었는데, 이 모델은 3.8B 매개변수에서 학습합니다.

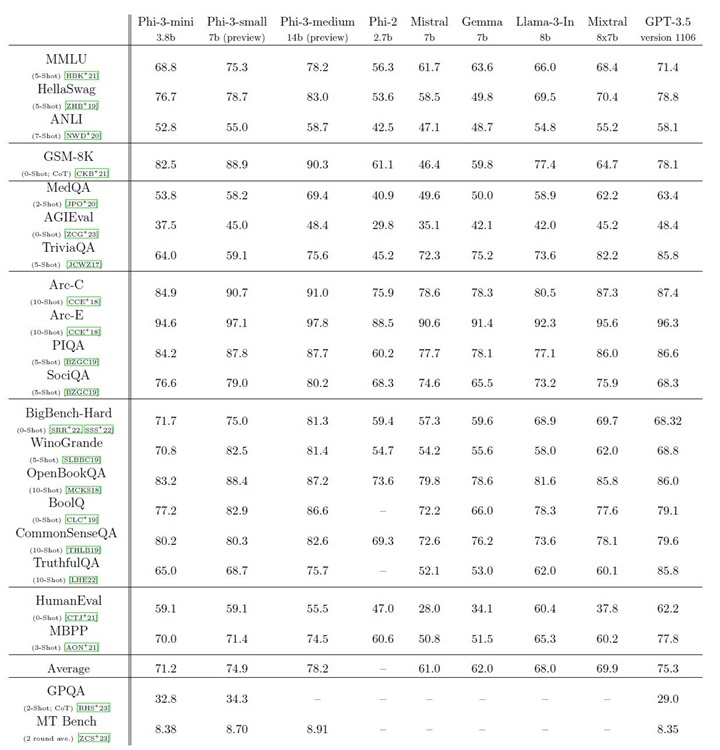

Phi-3 제품군에는 Phi-3 Small(7B)과 Phi-3 Medium(14B)이라는 두 가지 모델이 더 있지만 아직 출시되지 않았습니다. 가장 작은 Phi-3 Mini의 경우 MMLU 벤치마크에서 메타 라마 3 8B, 구글 젬마 7B 및 미스트랄 7B보다 성능이 더 뛰어납니다. 또한 작은 크기에도 불구하고 믹스트랄 8x7b의 성능과 비슷해 매우 놀랍습니다.

휴먼에벌에서는 가장 작은 Phi-3 미니 모델이 젬마 7B와 미스트랄 7B보다 훨씬 더 나은 성능을 보였습니다. Microsoft는 스마트폰과 PC에서 로컬로 작동할 수 있는 강력한 소형 모델을 만들기 위해 많은 노력을 기울인 것 같습니다. 가장 좋은 점은 곧 출시될 Phi-3 Small 및 Phi-3 Medium 모델이 OpenAI의 GPT-3.5, Mixtral 8x7b 및 Llama 3 8B보다 앞서 있다는 것입니다. 꽤 인상적으로 들립니다.

Microsoft는 Phi-3가 강력하게 필터링된 웹 데이터와 합성 데이터로 구성된 깨끗한 데이터 세트로 높은 성능을 달성한다고 주장합니다. 이 모델은 안전성, 유해성 및 견고성에 대한 추가 검증을 거쳤습니다. Phi-3 모델은 소형 모델 중 새로운 왕이 된 것 같습니다. 이 모델을 테스트하여 Claude 3 제품군 중 가장 작은 모델인 Anthropic의 하이쿠보다 성능이 더 뛰어난지 빨리 보고 싶네요.

Microsoft의 새로운 Phi-3 미니 모델을 테스트해보고 싶으신가요? 아래 댓글로 알려주세요. 그동안 PC에서 로컬로 구글의 젬마 모델을 실행하는 방법을 알아볼 수 있습니다.

Mark Otto