Раньше, в феврале, OpenAI представил функцию «Память», которая запоминает ключевые детали и предпочтения во всех ваших чатах. Теперь эта функция распространяется на всех платных пользователей ChatGPT Plus. Это попытка OpenAI сделать ваш опыт общения в чате более персональным и действовать как персонализированный помощник.

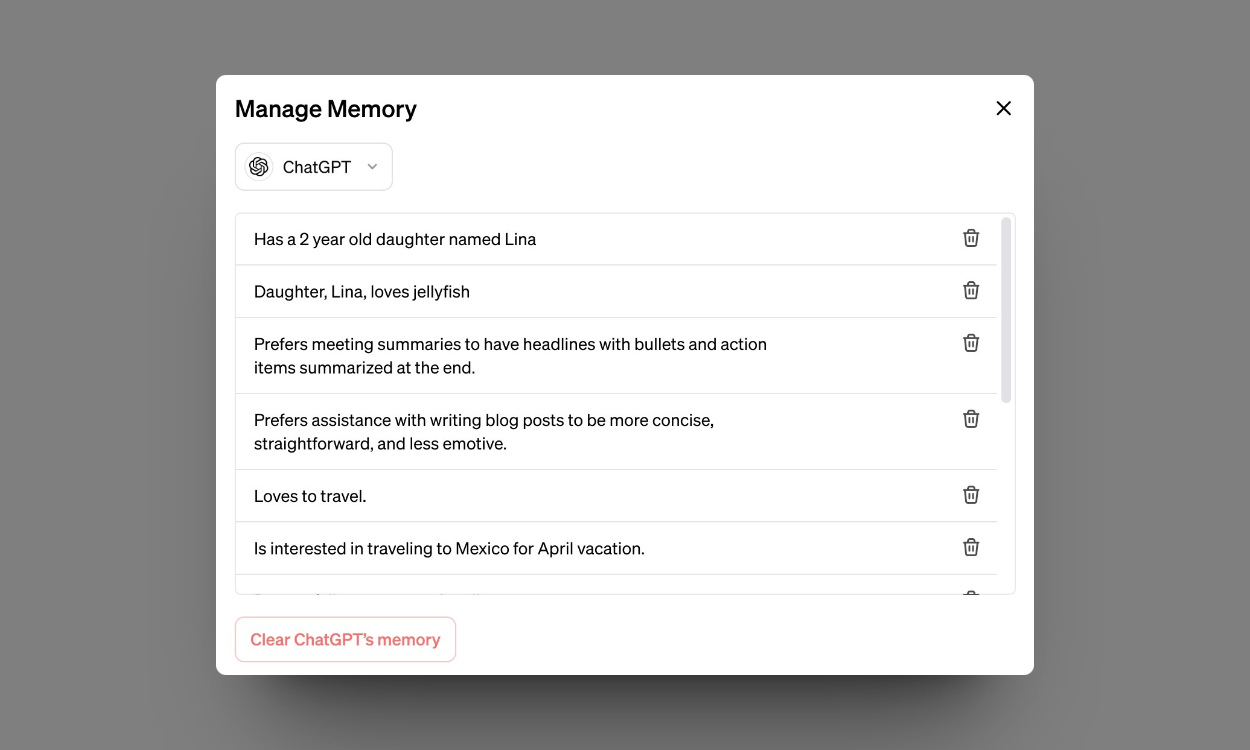

К примеру, ChatGPT теперь может запоминать предпочтения таких людей, как вы, например, любите путешествовать, предпочитаете краткое изложение, лаконичные ответы в качестве выходных данных и многое другое. Функция «Память» может запоминать все — от общих предпочтений до личных деталей — и использовать эту информацию для более индивидуального ответа в чате.

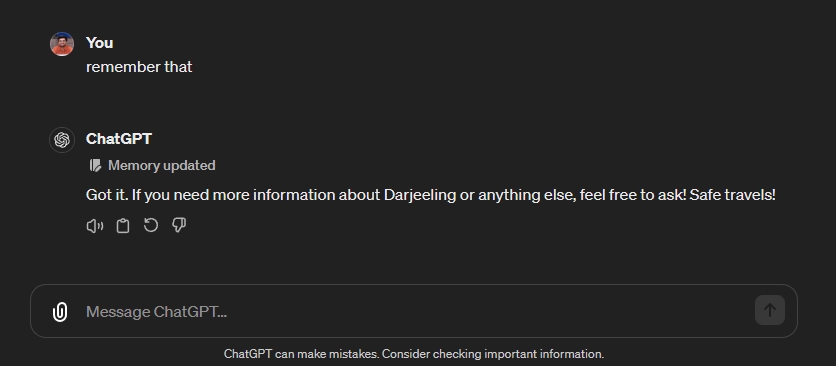

Функция включена по умолчанию, и ChatGPT автоматически обновляет память, когда сталкивается с такой информацией во время чата. Вы увидите диалог «Память обновлена» всякий раз, когда он что-то вспомнит. Вы также можете написать «запомнить» в подсказке, чтобы сохранить информацию для будущих чатов.

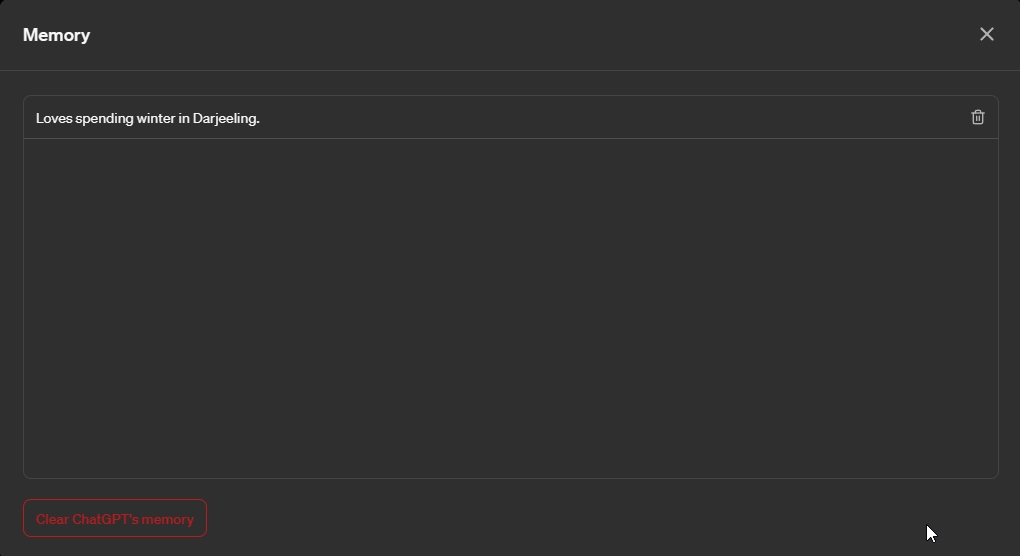

Кроме того, вы можете отключить функцию памяти в ChatGPT. Некоторые пользователи не хотят, чтобы ChatGPT запоминал личные данные, опасаясь риска конфиденциальности. Вы можете просто сказать «забыть«, когда он обновляет память, или управлять всеми воспоминаниями и удалять их из меню настроек. Управлять воспоминаниями можно в разделе Настройки -> Персонализация.

Чтобы сделать ChatGPT более индивидуальным, OpenAI ранее запустил Custom Instructions, где вы можете добавить детали о себе, чтобы ChatGPT знал вас лучше. А теперь, с появлением функции «Память», ChatGPT, вероятно, станет еще более персональным.

Хотя функция может быть полезной, пользователи ChatGPT должны знать, что все ваши чаты в любом случае используются для обучения модели, и она включена по умолчанию. Однако существует секретный способ отказаться от обучения моделей в ChatGPT. Следуйте нашему руководству по ссылке и получите подробные инструкции.

Заботящиеся о конфиденциальности пользователи должны предпринять эти активные шаги, чтобы их личные данные не стали частью набора данных для обучения. В последнее время компании ищут всевозможные данные и даже генерируют синтетические данные для обучения своих моделей.