На мероприятии Spring Update компания OpenAI представила свою последнюю флагманскую модель под названием GPT-4o («Omni»), и она будет доступна всем, включая бесплатных и платных пользователей ChatGPT. Наконец, бесплатные пользователи получают доступ к интеллекту класса GPT-4 без какой-либо платы. Кроме того, все инструменты и премиум-функции ChatGPT Plus становятся доступны и бесплатным пользователям.

Кроме того, бесплатные пользователи могут выходить в Интернет через ChatGPT; загружать изображения и пользоваться возможностями зрения GPT-4o; загружать и анализировать файлы и документы; создавать диаграммы и выполнять расширенный анализ данных (ранее называвшийся интерпретатором кода); включать функцию памяти, а также получать доступ к GPT и магазину GPT Store.

По сути, OpenAI переносит все платные функции в бесплатную версию ChatGPT. По словам OpenAI, новая модель будет внедрена для всех пользователей в ближайшие несколько недель. Не забывайте, что для бесплатных пользователей существует ограничение на количество сообщений. Как только вы достигнете этого предела, вы будете автоматически переключены на модель GPT-3.5.

GPT-4o действительно мультимодален

Самая важная особенность GPT-4o заключается в том, что это мультимодальная модель с самого начала. Ранее OpenAI использовал разные модели для разных модальностей, что увеличивало задержку, приводило к прерываниям и плохому опыту. В голосовом чате для обработки голоса использовался Whisper, для зрения — GPT-4V, а для обработки текста и рассуждений — GPT-4.

Однако модель GPT-4o может обрабатывать все три модальности, включая текст, звук и зрение одновременно, и рассуждать разумно. В некоторых демонстрациях, показанных на сцене, создавалось впечатление, что это сцена прямо из фильма «Она». Конечно, чтобы испытать нечто подобное, необходимо хорошее интернет-соединение.

Модель GPT-4o может видеть предметы в реальном времени и выражать чувства естественным образом, используя различные тона. Теперь разговор кажется менее роботизированным и более спонтанным. Вы также можете начать говорить, чтобы прервать его и продолжить разговор.

Кроме того, модель GPT-4o понимает, какие эмоции скрываются за вашим голосом. Например, если вы чувствуете беспокойство и учащенно дышите, она подскажет вам, что нужно успокоиться. Она также может переводить языки в режиме реального времени. По словам OpenAI, новая модель GPT-4o поддерживает 50 языков.

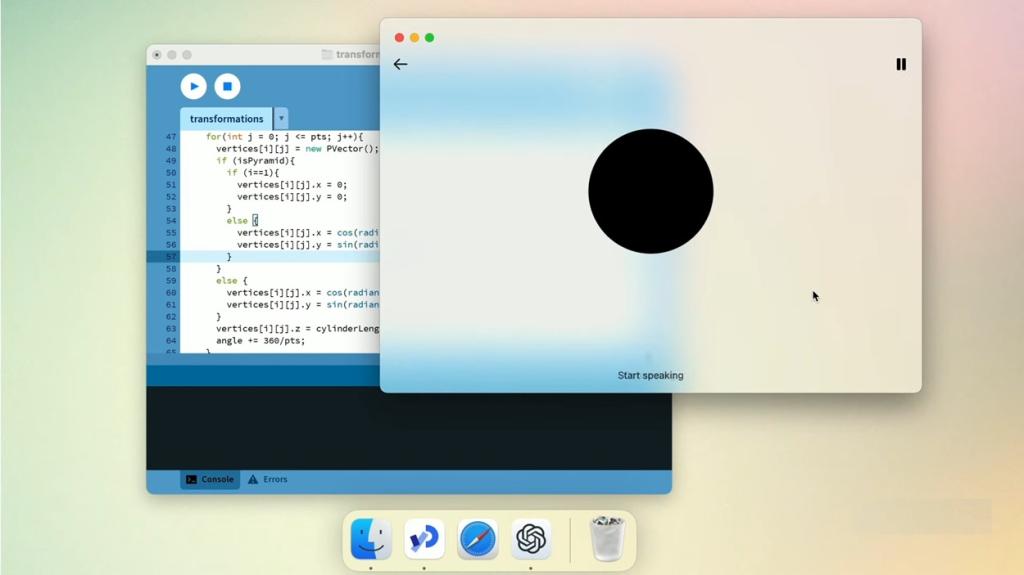

ChatGPT получил настольное приложение для macOS

Наконец-то ChatGPT получил настольное приложение для macOS. Теперь вы можете общаться голосом с ChatGPT и на Mac. OpenAI добавила в свое приложение для macOS возможность видения, что действительно замечательно. Вы можете включить зрение, и приложение сможет видеть ваш экран. Если вы пишете и хотите, чтобы ChatGPT взглянул на ваш код, он сможет увидеть его и рассуждать с ним. Это очень здорово. Не знаю, появится ли подобное приложение ChatGPT для Windows.

Что касается разработчиков, то новая модель GPT-4o будет доступна на API. Она на 50 % дешевле, предлагает в 2 раза большую производительность и обеспечивает в 5 раз более высокий лимит скорости, чем GPT-4 Turbo.

Теперь, когда OpenAI предоставила все платные функции бесплатным пользователям, вы, возможно, задаетесь вопросом, что же остается пользователям ChatGPT Plus. По словам OpenAI, у платных пользователей будет в 5 раз больше возможностей, чем у бесплатных. Кроме того, OpenAI очень скоро выпустит следующую «пограничную» модель, объявила Мира Мурати в конце мероприятия. Так что платные пользователи определенно получат доступ к «следующей большой вещи» совсем скоро.